Диапазон коэффициента корреляции. Корреляционный анализ. Подробный пример решения. Условия использования метода

Где x·y , x , y - средние значения выборок; σ(x), σ(y) - среднеквадратические отклонения.

Кроме того, коэффициент линейной парной корреляции Пирсона

может быть определен через коэффициент регрессии b: , где σ(x)=S(x), σ(y)=S(y) - среднеквадратические отклонения, b - коэффициент перед x в уравнении регрессии y=a+bx .

Другие варианты формул:

или

К xy - корреляционный момент (коэффициент ковариации)

Для нахождения линейного коэффициента корреляции Пирсона необходимо найти выборочные средние x и y , и их среднеквадратические отклонения σ x = S(x), σ y = S(y):

Для нахождения линейного коэффициента корреляции Пирсона необходимо найти выборочные средние x и y , и их среднеквадратические отклонения σ x = S(x), σ y = S(y):

Линейный коэффициент корреляции указывает на наличие связи и принимает значения от –1 до +1 (см. шкалу Чеддока). Например, при анализе тесноты линейной корреляционной связи между двумя переменными получен коэффициент парной линейной корреляции, равный –1 . Это означает, что между переменными существует точная обратная линейная зависимость.

Вычислить значение коэффициента корреляции можно по заданным средним выборки, либо непосредственно .

Xy#x #y #σ x #σ y " data-id="a;b;c;d;e" data-formul="(a-b*c)/(d*e)" data-r="r xy ">Рассчитать свое значение

Геометрический смысл коэффициента корреляции : r xy показывает, насколько различается наклон двух линий регрессии: y(x) и х(у) , насколько сильно различаются результаты минимизации отклонений по x и по y . Чем больше угол между линиями, то тем больше r xy .Знак коэффициента корреляции совпадает со знаком коэффициента регрессии и определяет наклон линии регрессии, т.е. общую направленность зависимости (возрастание или убывание). Абсолютная величина коэффициента корреляции определяется степенью близости точек к линии регрессии.

Свойства коэффициента корреляции

- |r xy | ≤ 1;

- если X и Y независимы, то r xy =0, обратное не всегда верно;

- если |r xy |=1, то Y=aX+b, |r xy (X,aX+b)|=1, где a и b постоянные, а ≠ 0;

- |r xy (X,Y)|=|r xy (a 1 X+b 1 , a 2 X+b 2)|, где a 1 , a 2 , b 1 , b 2 – постоянные.

Поэтому для проверки направления связи выбирается проверка гипотезы при помощи коэффициента корреляции Пирсона с дальнейшей проверкой на достоверность при помощи t-критерия (пример см. ниже).

Инструкция . Укажите количество исходных данных. Полученное решение сохраняется в файле Word (см. Пример нахождения уравнения регрессии). Также автоматически создается шаблон решения в Excel . .

Типовые задания (см. также нелинейная регрессия)

Типовые задания

Исследуется зависимость производительности труда y от уровня механизации работ x (%) по данным 14 промышленных предприятий. Статистические данные приведены в таблице.

Требуется:

1) Найти оценки параметров линейной регрессии у на х. Построить диаграмму рассеяния и нанести прямую регрессии на диаграмму рассеяния.

2) На уровне значимости α=0.05 проверить гипотезу о согласии линейной регрессии с результатами наблюдений.

3) С надежностью γ=0.95 найти доверительные интервалы для параметров линейной регрессии.

Вместе с этим калькулятором также используют следующие:

Уравнение множественной регрессии

Пример . На основе данных, приведенных в Приложении 1 и соответствующих Вашему варианту (таблица 2), требуется:

- Рассчитать коэффициент линейной парной корреляции и построить уравнение линейной парной регрессии одного признака от другого. Один из признаков, соответствующих Вашему варианту, будет играть роль факторного (х), другой – результативного (y). Причинно-следственные связи между признаками установить самим на основе экономического анализа. Пояснить смысл параметров уравнения.

- Определить теоретический коэффициент детерминации и остаточную (необъясненную уравнением регрессии) дисперсию. Сделать вывод.

- Оценить статистическую значимость уравнения регрессии в целом на пятипроцентном уровне с помощью F-критерия Фишера. Сделать вывод.

- Выполнить прогноз ожидаемого значения признака-результата y при прогнозном значении признака-фактора х, составляющим 105% от среднего уровня х. Оценить точность прогноза, рассчитав ошибку прогноза и его доверительный интервал с вероятностью 0,95.

Средние значения

Дисперсия

Среднеквадратическое отклонение

Связь между признаком Y фактором X сильная и прямая (определяется по шкале Чеддока).

Уравнение регрессии

Коэффициент регрессии: k = a = 4.01

Коэффициент детерминации

R 2 = 0.99 2 = 0.97, т.е. в 97% случаев изменения х приводят к изменению y . Другими словами - точность подбора уравнения регрессии - высокая. Остаточная дисперсия: 3%.

| x | y | x 2 | y 2 | x ∙ y | y(x) | (y-y cp) 2 | (y-y(x)) 2 | (x-x p) 2 |

| 1 | 107 | 1 | 11449 | 107 | 103.19 | 333.06 | 14.5 | 30.25 |

| 2 | 109 | 4 | 11881 | 218 | 107.2 | 264.06 | 3.23 | 20.25 |

| 3 | 110 | 9 | 12100 | 330 | 111.21 | 232.56 | 1.47 | 12.25 |

| 4 | 113 | 16 | 12769 | 452 | 115.22 | 150.06 | 4.95 | 6.25 |

| 5 | 120 | 25 | 14400 | 600 | 119.23 | 27.56 | 0.59 | 2.25 |

| 6 | 122 | 36 | 14884 | 732 | 123.24 | 10.56 | 1.55 | 0.25 |

| 7 | 123 | 49 | 15129 | 861 | 127.26 | 5.06 | 18.11 | 0.25 |

| 8 | 128 | 64 | 16384 | 1024 | 131.27 | 7.56 | 10.67 | 2.25 |

| 9 | 136 | 81 | 18496 | 1224 | 135.28 | 115.56 | 0.52 | 6.25 |

| 10 | 140 | 100 | 19600 | 1400 | 139.29 | 217.56 | 0.51 | 12.25 |

| 11 | 145 | 121 | 21025 | 1595 | 143.3 | 390.06 | 2.9 | 20.25 |

| 12 | 150 | 144 | 22500 | 1800 | 147.31 | 612.56 | 7.25 | 30.25 |

| 78 | 1503 | 650 | 190617 | 10343 | 1503 | 2366.25 | 66.23 | 143 |

Примечание: значения y(x) находятся из полученного уравнения регрессии:

y(1) = 4.01*1 + 99.18 = 103.19

y(2) = 4.01*2 + 99.18 = 107.2

... ... ...

Значимость коэффициента корреляции

Выдвигаем гипотезы:H 0: r xy = 0, нет линейной взаимосвязи между переменными;

H 1: r xy ≠ 0, есть линейная взаимосвязь между переменными;

Для того чтобы при уровне значимости α проверить нулевую гипотезу о равенстве нулю генерального коэффициента корреляции нормальной двумерной случайной величины при конкурирующей гипотезе H 1 ≠ 0, надо вычислить наблюдаемое значение критерия (величина случайной ошибки):

По таблице Стьюдента находим t табл (n-m-1;α/2) = (10;0.025) = 2.228

Поскольку Tнабл > t табл, то отклоняем гипотезу о равенстве 0 коэффициента корреляции. Другими словами, коэффициент корреляции статистически - значим.

Интервальная оценка для коэффициента корреляции (доверительный интервал)

r - Δ r ≤ r ≤ r + Δ r

Δ r = ±t табл m r = ±2.228 0.0529 = 0.118

0.986 - 0.118 ≤ r ≤ 0.986 + 0.118

Доверительный интервал для коэффициента корреляции: 0.868 ≤ r ≤ 1

Анализ точности определения оценок коэффициентов регрессии

Доверительные интервалы для зависимой переменной

Рассчитаем границы интервала, в котором будет сосредоточено 95% возможных значений Y при неограниченно большом числе наблюдений и X = 7

(122.4;132.11)

Проверка гипотез относительно коэффициентов линейного уравнения регрессии

1) t-статистика

Статистическая значимость коэффициента регрессии подтверждается

Доверительный интервал для коэффициентов уравнения регрессии

Определим доверительные интервалы коэффициентов регрессии, которые с надежность 95% будут следующими:

(a - t a S a ; a + t a S a)

(3.6205;4.4005)

(b - t b S b ; b + t b S b)

(96.3117;102.0519)

2) F-статистики

Fkp = 4.96. Поскольку F > Fkp, то коэффициент детерминации статистически значим (см.

Критерий корреляции Пирсона – это метод параметрической статистики, позволяющий определить наличие или отсутствие линейной связи между двумя количественными показателями, а также оценить ее тесноту и статистическую значимость. Другими словами, критерий корреляции Пирсона позволяет определить, есть ли линейная связь между изменениями значений двух переменных. В статистических расчетах и выводах коэффициент корреляции обычно обозначается как r xy или R xy .

1. История разработки критерия корреляции

Критерий корреляции Пирсона был разработан командой британских ученых во главе с Карлом Пирсоном (1857-1936) в 90-х годах 19-го века, для упрощения анализа ковариации двух случайных величин. Помимо Карла Пирсона над критерием корреляции Пирсона работали также Фрэнсис Эджуорт и Рафаэль Уэлдон .

2. Для чего используется критерий корреляции Пирсона?

Критерий корреляции Пирсона позволяет определить, какова теснота (или сила) корреляционной связи между двумя показателями, измеренными в количественной шкале. При помощи дополнительных расчетов можно также определить, насколько статистически значима выявленная связь.

Например, при помощи критерия корреляции Пирсона можно ответить на вопрос о наличии связи между температурой тела и содержанием лейкоцитов в крови при острых респираторных инфекциях, между ростом и весом пациента, между содержанием в питьевой воде фтора и заболеваемостью населения кариесом.

3. Условия и ограничения применения критерия хи-квадрат Пирсона

- Сопоставляемые показатели должны быть измерены в количественной шкале (например, частота сердечных сокращений, температура тела, содержание лейкоцитов в 1 мл крови, систолическое артериальное давление).

- Посредством критерия корреляции Пирсона можно определить лишь наличие и силу линейной взаимосвязи между величинами. Прочие характеристики связи, в том числе направление (прямая или обратная), характер изменений (прямолинейный или криволинейный), а также наличие зависимости одной переменной от другой - определяются при помощи регрессионного анализа .

- Количество сопоставляемых величин должно быть равно двум. В случае анализ взаимосвязи трех и более параметров следует воспользоваться методом факторного анализа .

- Критерий корреляции Пирсона является параметрическим , в связи с чем условием его применения служит нормальное распределение сопоставляемых переменных. В случае необходимости корреляционного анализа показателей, распределение которых отличается от нормального, в том числе измеренных в порядковой шкале, следует использовать коэффициент ранговой корреляции Спирмена .

- Следует четко различать понятия зависимости и корреляции. Зависимость величин обуславливает наличие корреляционной связи между ними, но не наоборот.

Например, рост ребенка зависит от его возраста, то есть чем старше ребенок, тем он выше. Если мы возьмем двух детей разного возраста, то с высокой долей вероятности рост старшего ребенка будет больше, чем у младшего. Данное явление и называется зависимостью , подразумевающей причинно-следственную связь между показателями. Разумеется, между ними имеется и корреляционная связь , означающая, что изменения одного показателя сопровождаются изменениями другого показателя.

В другой ситуации рассмотрим связь роста ребенка и частоты сердечных сокращений (ЧСС). Как известно, обе эти величины напрямую зависят от возраста, поэтому в большинстве случаев дети большего роста (а значит и более старшего возраста) будут иметь меньшие значения ЧСС. То есть, корреляционная связь будет наблюдаться и может иметь достаточно высокую тесноту. Однако, если мы возьмем детей одного возраста , но разного роста , то, скорее всего, ЧСС у них будет различаться несущественно, в связи с чем можно сделать вывод о независимости ЧСС от роста.

Приведенный пример показывает, как важно различать фундаментальные в статистике понятия связи и зависимости показателей для построения верных выводов.

4. Как рассчитать коэффициента корреляции Пирсона?

Расчет коэффициента корреляции Пирсона производится по следующей формуле:

5. Как интерпретировать значение коэффициента корреляции Пирсона?

Значения коэффициента корреляции Пирсона интерпретируются исходя из его абсолютных значений. Возможные значения коэффициента корреляции варьируют от 0 до ±1. Чем больше абсолютное значение r xy – тем выше теснота связи между двумя величинами. r xy = 0 говорит о полном отсутствии связи. r xy = 1 – свидетельствует о наличии абсолютной (функциональной) связи. Если значение критерия корреляции Пирсона оказалось больше 1 или меньше -1 – в расчетах допущена ошибка.

Для оценки тесноты, или силы, корреляционной связи обычно используют общепринятые критерии, согласно которым абсолютные значения r xy < 0.3 свидетельствуют о слабой связи, значения r xy от 0.3 до 0.7 - о связи средней тесноты, значения r xy > 0.7 - о сильной связи.

Более точную оценку силы корреляционной связи можно получить, если воспользоваться таблицей Чеддока :

Оценка статистической значимости коэффициента корреляции r xy осуществляется при помощи t-критерия, рассчитываемого по следующей формуле:

![]()

Полученное значение t r сравнивается с критическим значением при определенном уровне значимости и числе степеней свободы n-2. Если t r превышает t крит, то делается вывод о статистической значимости выявленной корреляционной связи.

6. Пример расчета коэффициента корреляции Пирсона

Целью исследования явилось выявление, определение тесноты и статистической значимости корреляционной связи между двумя количественными показателями: уровнем тестостерона в крови (X) и процентом мышечной массы в теле (Y). Исходные данные для выборки, состоящей из 5 исследуемых (n = 5), сведены в таблице.

В статистике коэффициент корреляции (англ. Correlation Coefficient ) используется для проверки гипотезы о существовании зависимости между двумя случайными величинами, а также позволяет оценить ее силу. В портфельной теории этот показатель, как правило, используется для определения характера и силы зависимости между доходностью ценной бумаги (актива) и доходностью портфеля . Если распределение этих переменных является нормальным или близким к нормальному, то следует использовать коэффициент корреляции Пирсона , который рассчитывается по следующей формуле:

Среднеквадратическое отклонение доходности акций Компании А составит 0,6398, акций Компании Б 0,5241 и портфеля 0,5668. (О том, как рассчитывается среднеквадратическое отклонение можно прочитать )

Коэффициент корреляции доходности акций Компании А и доходности портфеля составит -0,864, а акций Компании Б 0,816.

R A = -0,313/(0,6389*0,5668) = -0,864

R Б = 0,242/(0,5241*0,5668) = 0,816

Можно сделать вывод о присутствии достаточно сильной взаимосвязи между доходностью портфеля и доходностью акций Компании А и Компании Б. При этом, доходность акций Компании А демонстрирует разнонаправленное движение с доходностью портфеля, а доходность акций Компании Б однонаправленное движение.

КУРСОВАЯ РАБОТА

Тема: Корреляционный анализ

Введение

1. Корреляционный анализ

1.1 Понятие корреляционной связи

1.2 Общая классификация корреляционных связей

1.3 Корреляционные поля и цель их построения

1.4 Этапы корреляционного анализа

1.5 Коэффициенты корреляции

1.6 Нормированный коэффициент корреляции Браве-Пирсона

1.7 Коэффициент ранговой корреляции Спирмена

1.8 Основные свойства коэффициентов корреляции

1.9 Проверка значимости коэффициентов корреляции

1.10 Критические значения коэффициента парной корреляции

2. Планирование многофакторного эксперимента

2.1 Условие задачи

2.2 Определение центр плана (основной уровень) и уровня варьирования факторов

2.3 Построение матрицы планирования

2.4 Проверка однородности дисперсии и равноточности измерения в разных сериях

2.5 Коэффициенты уравнения регрессии

2.6 Дисперсия воспроизводимости

2.7 Проверка значимости коэффициентов уравнения регрессии

2.8 Проверка адекватности уравнения регрессии

Заключение

Список литературы

ВВЕДЕНИЕ

Планирование эксперимента -математико-статистическая дисциплина, изучающая методы рациональной организации экспериментальных исследований - от оптимального выбора исследуемых факторов и определения собственно плана эксперимента в соответствии с его целью до методов анализа результатов. Начало планирования эксперимента положили труды английского статистика Р.Фишера (1935), подчеркнувшего, что рациональное планирование экспериментадаёт не менее существенный выигрыш в точности оценок, чем оптимальная обработка результатов измерений. В 60-х годах 20 века сложилась современная теория планирования эксперимента. Её методы тесно связаны с теорией приближения функций и математическим программированием. Построены оптимальные планы и исследованы их свойства для широкого класса моделей.

Планирование эксперимента – выбор плана эксперимента, удовлетворяющего заданным требованиям, совокупность действий направленных на разработку стратегии экспериментирования (от получения априорной информации до получения работоспособной математической модели или определения оптимальных условий). Это целенаправленное управление экспериментом, реализуемое в условиях неполного знания механизма изучаемого явления.

В процессе измерений, последующей обработки данных, а также формализации результатов в виде математической модели, возникают погрешности и теряется часть информации, содержащейся в исходных данных. Применение методов планирования эксперимента позволяет определить погрешность математической модели и судить о ее адекватности. Если точность модели оказывается недостаточной, то применение методов планирования эксперимента позволяет модернизировать математическую модель с проведением дополнительных опытов без потери предыдущей информации и с минимальными затратами.

Цель планирования эксперимента – нахождение таких условий и правил проведения опытов при которых удается получить надежную и достоверную информацию об объекте с наименьшей затратой труда, а также представить эту информацию в компактной и удобной форме с количественной оценкой точности.

Среди основных методов планирования, применяемых на разных этапах исследования, используют:

Планирование отсеивающего эксперимента, основное значение которого выделение из всей совокупности факторов группы существенных факторов, подлежащих дальнейшему детальному изучению;

Планирование эксперимента для дисперсионного анализа, т.е. составление планов для объектов с качественными факторами;

Планирование регрессионного эксперимента, позволяющего получать регрессионные модели (полиномиальные и иные);

Планирование экстремального эксперимента, в котором главная задача – экспериментальная оптимизация объекта исследования;

Планирование при изучении динамических процессов и т.д.

Целью изучения дисциплины является подготовка студентов к производственно-технической деятельности по специальности с применением методов теории планирования и современных информационных технологий.

Задачи дисциплины: изучение современных методов планирования, организации и оптимизации научного и промышленного эксперимента, проведения экспериментов и обработки полученных результатов.

1. КОРРЕЛЯЦИОННЫЙ АНАЛИЗ

1.1 Понятие корреляционной связи

Исследователя нередко интересует, как связаны между собой две или большее количество переменных в одной или нескольких изучаемых выборках. Например, может ли рост влиять на вес человека или может ли давление влиять на качество продукции?

Такого рода зависимость между переменными величинами называется корреляционной, или корреляцией. Корреляционная связь - это согласованное изменение двух признаков, отражающее тот факт, что изменчивость одного признака находится в соответствии с изменчивостью другого.

Известно, например, что в среднем между ростом людей и их весом наблюдается положительная связь, и такая, что чем больше рост, тем больше вес человека. Однако из этого правила имеются исключения, когда относительно низкие люди имеют избыточный вес, и, наоборот, астеники, при высоком росте имеют малый вес. Причиной подобных исключений является то, что каждый биологический, физиологический или психологический признак определяется воздействием многих факторов: средовых, генетических, социальных, экологических и т.д.

Корреляционные связи - это вероятностные изменения, которые можно изучать только на представительных выборках методами математической статистики. Оба термина - корреляционная связь и корреляционная зависимость - часто используются как синонимы. Зависимость подразумевает влияние, связь - любые согласованные изменения, которые могут объясняться сотнями причин. Корреляционные связи не могут рассматриваться как свидетельство причинно-следственной зависимости, они свидетельствуют лишь о том, что изменениям одного признака, как правило, сопутствуют определенные изменения другого.

Корреляционная зависимость - это изменения, которые вносят значения одного признака в вероятность появления разных значений другого признака.

Задача корреляционного анализа сводится к установлению направления (положительное или отрицательное) и формы (линейная, нелинейная) связи между варьирующими признаками, измерению ее тесноты, и, наконец, к проверке уровня значимости полученных коэффициентов корреляции.

Корреляционные связи различаютсяпо форме, направлению и степени (силе).

По форме корреляционная связь может быть прямолинейной или криволинейной. Прямолинейной может быть, например, связь между количеством тренировок на тренажере и количеством правильно решаемых задач в контрольной сессии. Криволинейной может быть, например, связь между уровнем мотивации и эффективностью выполнения задачи (рисунок 1). При повышении мотивации эффективность выполнения задачи сначала возрастает, затем достигается оптимальный уровень мотивации, которому соответствует максимальная эффективность выполнения задачи; дальнейшему повышению мотивации сопутствует уже снижение эффективности.

Рисунок 1 - Связь между эффективностью решения задачи и силой мотивационной тенденции

По направлению корреляционная связь может быть положительной ("прямой") и отрицательной ("обратной"). При положительной прямолинейной корреляции более высоким значениям одного признака соответствуют более высокие значения другого, а более низким значениям одного признака - низкие значения другого (рисунок 2). При отрицательной корреляции соотношения обратные (рисунок 3). При положительной корреляции коэффициент корреляции имеет положительный знак, при отрицательной корреляции - отрицательный знак.

Рисунок 2 – Прямая корреляция

Рисунок 3 – Обратная корреляция

Рисунок 4 – Отсутствие корреляции

Степень, сила или теснота корреляционной связи определяется по величине коэффициента корреляции. Сила связи не зависит от ее направленности и определяется по абсолютному значению коэффициента корреляции.

1.2 Общая классификация корреляционных связей

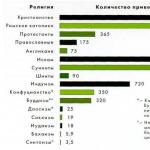

В зависимости от коэффициента корреляции различают следующие корреляционные связи:

Сильная, или тесная при коэффициенте корреляции r>0,70;

Средняя (при 0,50 Умеренная (при 0,30 Слабая (при 0,20 Очень слабая (при r<0,19). 1.3 Корреляционные поля и цель их построения

Корреляция изучается на основании экспериментальных данных, представляющих собой измеренные значения (x i

, y i) двух признаков. Если экспериментальных данных немного, то двумерное эмпирическое распределение представляется в виде двойного ряда значений x i

и y i

. При этом корреляционную зависимость между признаками можно описывать разными способами. Соответствие между аргументом и функцией может быть задано таблицей, формулой, графиком и т. д. Корреляционный анализ, как и другие статистические методы, основан на использовании вероятностных моделей, описывающих поведение исследуемых признаков в некоторой генеральной совокупности, из которой получены экспериментальные значения x i

и y i

. Когда исследуется корреляция между количественными признаками, значения которых можно точно измерить в единицах метрических шкал (метры, секунды, килограммы и т.д.), то очень часто принимается модель двумерной нормально распределенной генеральной совокупности. Такая модель отображает зависимость между переменными величинами x i

и y i

графически в виде геометрического места точек в системе прямоугольных координат. Эту графическую зависимость называются также диаграммой рассеивания или корреляционным полем. В математической статистике корреляцией является статистическая и вероятностная зависимость, которая не обладает строгим функциональным характером. Корреляционная зависимость появляется в том случае, когда один из признаков является зависящим как от данного второго, так и от ряда других случайных факторов. Коэффициент корреляции служит математической мерой зависимости двух случайных величин. Виды коэффициентов корреляции могут быть отрицательными и положительными. Расчеты, выполняемые с помощью корреляции, не являются очень сложными, но требуют особой внимательности от исполнителя при расчетах. При этих вычислениях вам обязательно понадобится инженерный калькулятор. Прежде чем выяснить, как найти коэффициент корреляции, необходимо уяснить смысл значений коэффициентов: Найти выборочный коэффициент корреляции, можно двумя методами: Ранговый метод заключается в следующем алгоритме действий: Метод квадратов включает в себя следующий алгоритм:

Данная модель двумерного нормального распределения (корреляционное поле) позволяет дать наглядную графическую интерпретацию коэффициента корреляции, т.к. распределение в совокупности зависит от пяти параметров: μ x

, μ y

– средние значения (математические ожидания); σ x

,σ y

– стандартные отклонения случайных величин Х и Y и р – коэффициент корреляции, который является мерой связи между случайными величинами Х и Y.

Если р = 0, то значения, x i

, y i

, полученные из двумерной нормальной совокупности, располагаются на графике в координатах х, у в пределах области, ограниченной окружностью (рисунок 5, а). В этом случае между случайными величинами Х и Y отсутствует корреляция и они называются некоррелированными. Для двумерного нормального распределения некоррелированность означает одновременно и независимость случайных величин Х и Y.Порядок и метод расчета коэффициента корреляции

Ранговый метод

Метод квадратов

Рекомендуем также